下载官方版:

Anaconda3的安装python

Anaconda 下载地址:

https://www.anaconda.com/products/individual#download-section

清华大学开源软件站

https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/

https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/Anaconda3-5.2.0-Linux-x86_64.sh

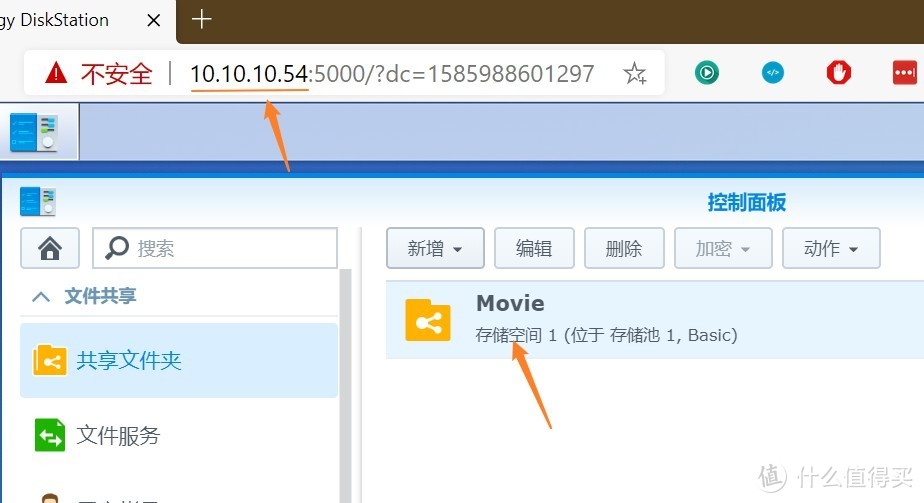

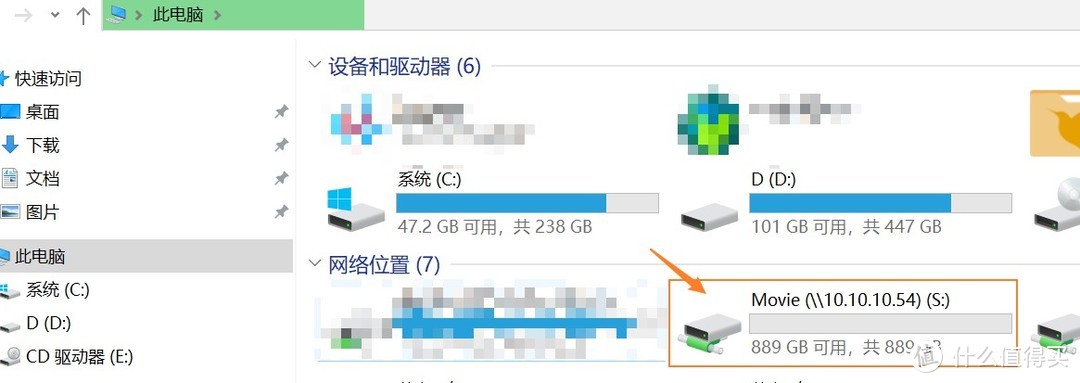

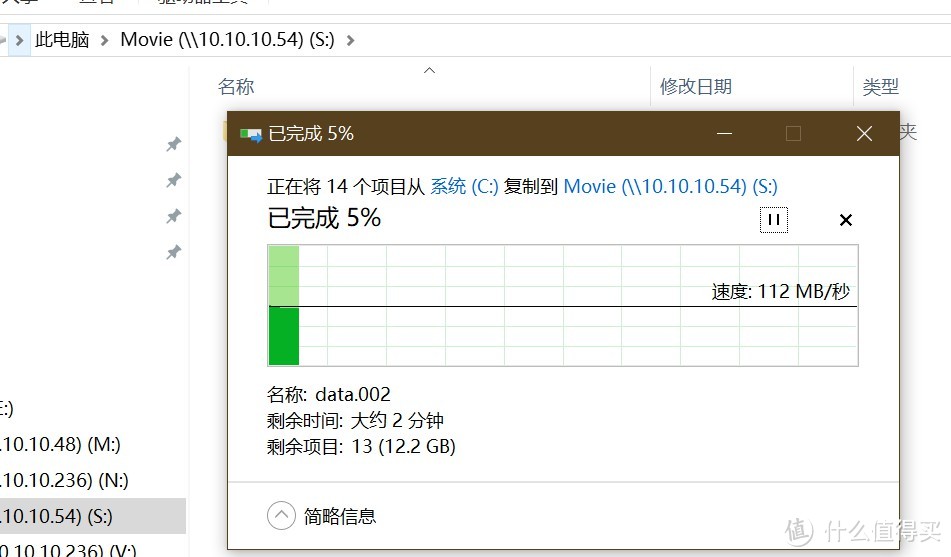

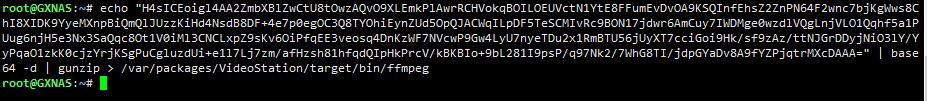

一、本地下载64-Bit (x86) Anaconda3-5.2.0-Linux-x86_64.sh,并经过winscp将其上传到群晖的/root/目录下。linux

wget –show-progress -cqO ./anaconda/Anaconda3-5.2.0-Linux-x86_64.sh https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/Anaconda3-5.2.0-Linux-x86_64.sh

wget –no-check-certificate -qO- https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/Anaconda3-5.2.0-Linux-x86_64.sh

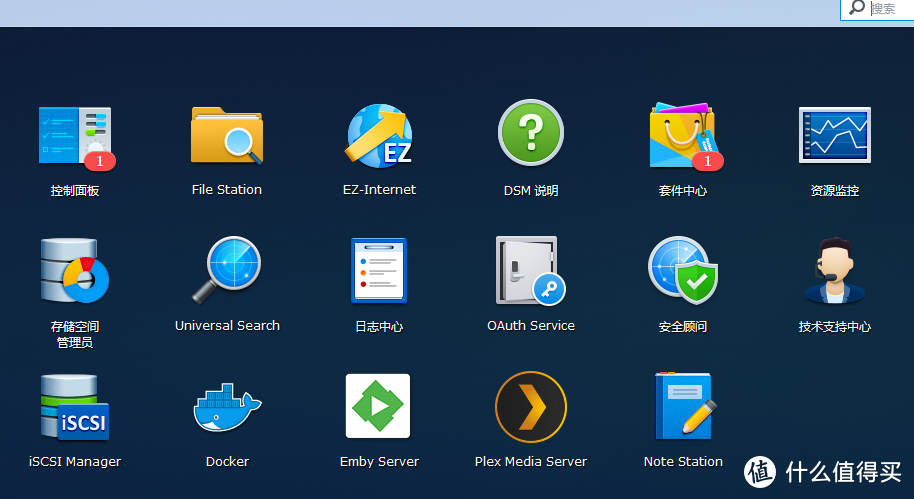

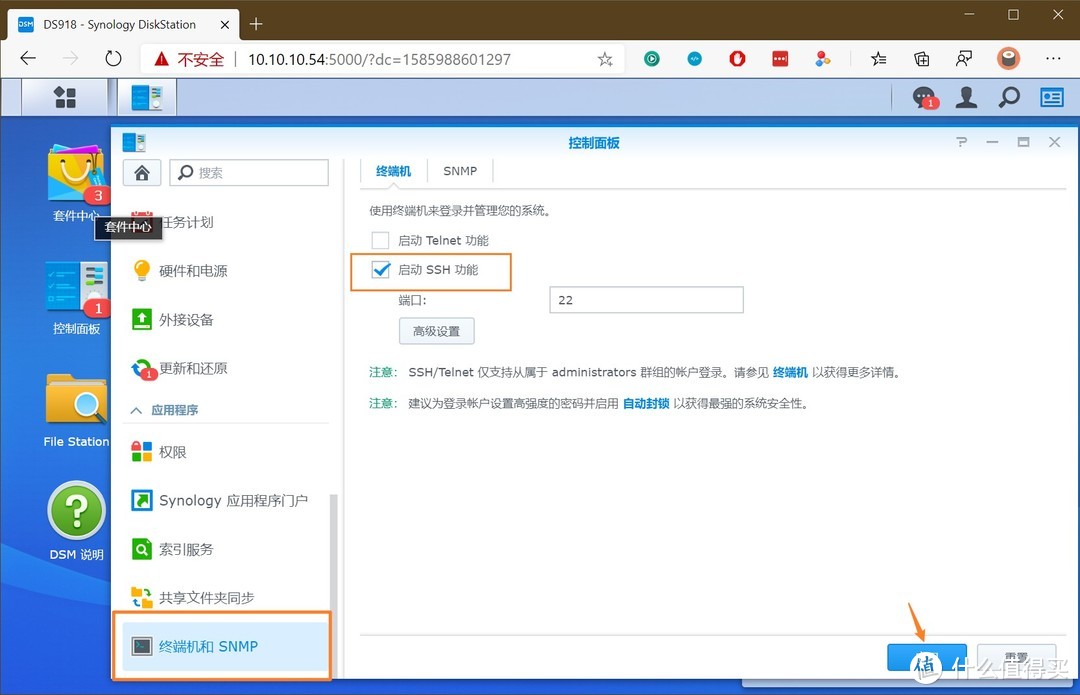

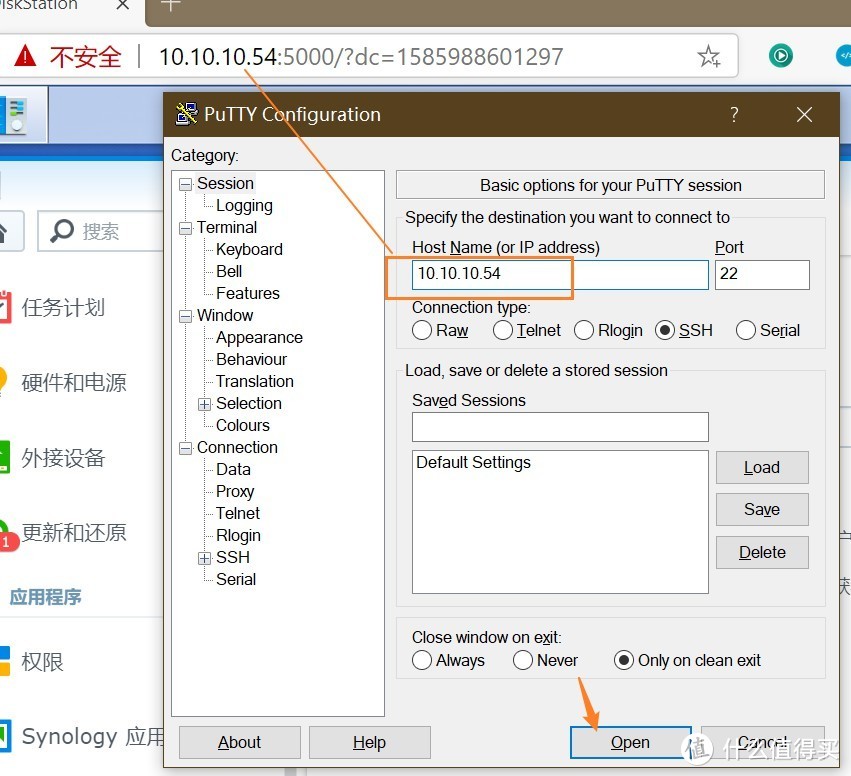

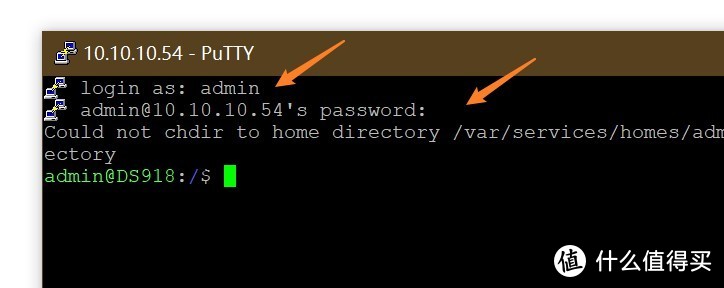

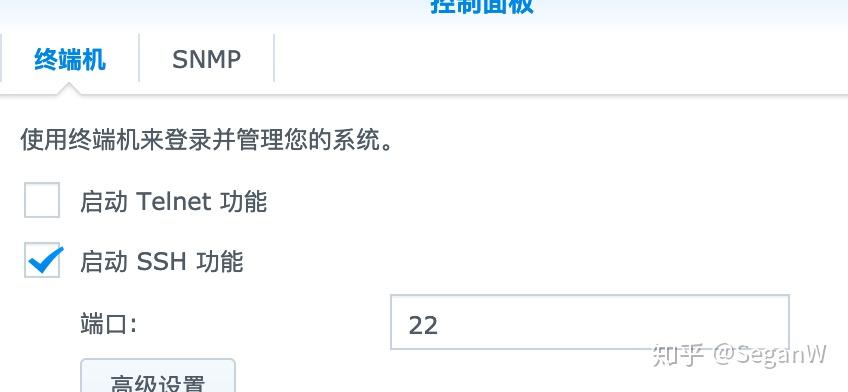

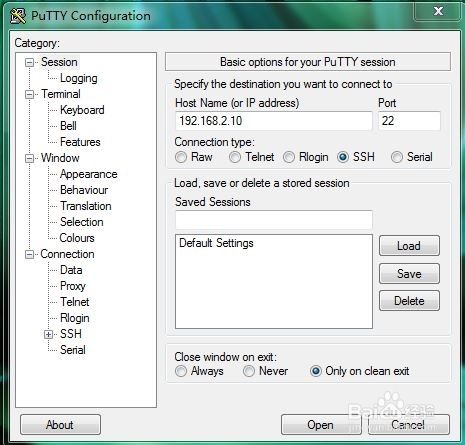

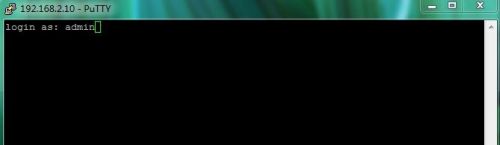

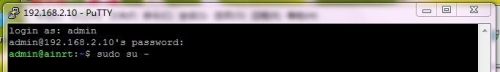

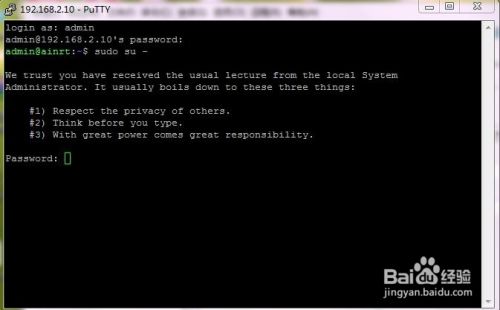

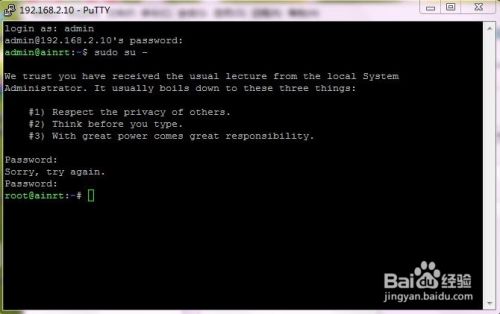

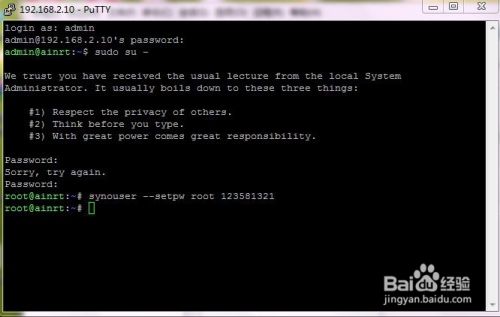

二、切换到root目录下(使用root登陆putty)docker

cd /root/

三、在Linux里面.sh文件是可执行的脚本文件,须要用命令bash来进行安装vim

bash ./Anaconda3-5.2.0-Linux-x86_64.sh.sh

四、回车-接受协议,接受协议(yes),输入安装路径(直接回车可以使用默认安装路径),操做以下图所示:bash

五、设置环境变量,其中./bashrc为当前用户有效,能够选择no,(可设置全部用户有效,编辑/etc/profile文件,由于只是固定跑一些版本,此处本人未设置),添加环境变量: spa

export ANACONDA_HOME=安装路径3d

export PATH=$ANACONDA_HOME/bin:$PATHcode

最后生效profile文件,验证是否安装成功(#python)blog

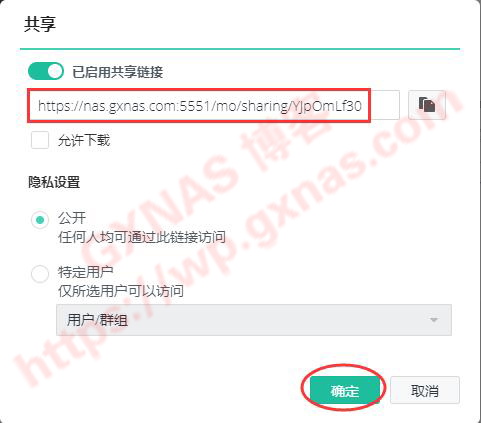

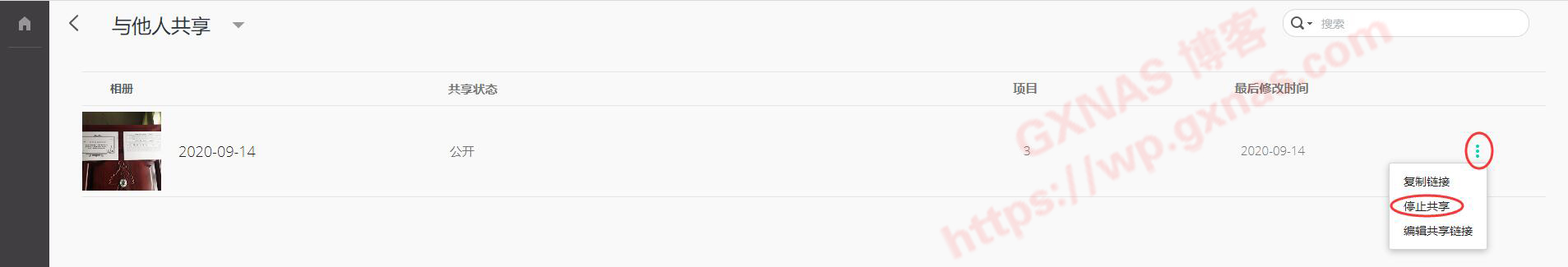

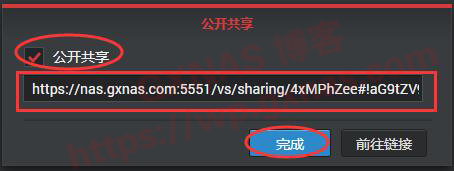

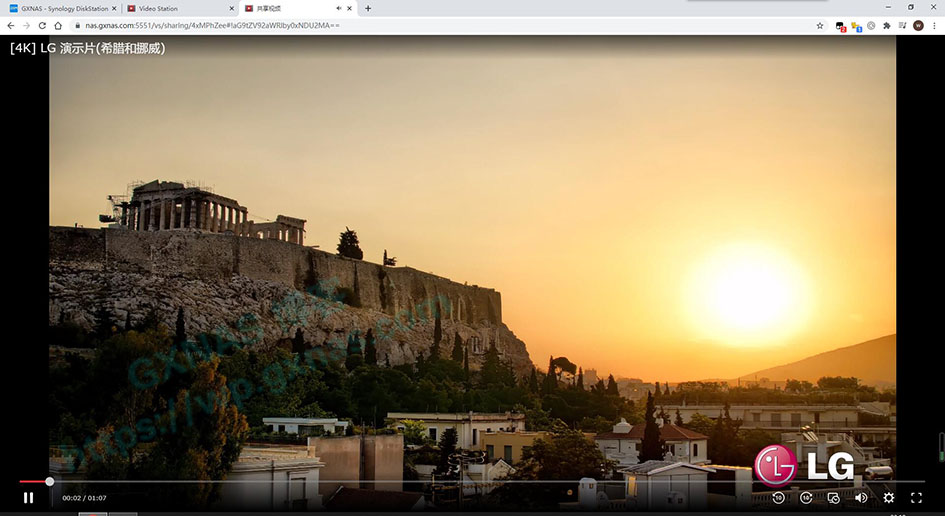

jupyter notebook 的设置ip

>>>设置目标:局域网可访问,且随群晖开机启动

1.使用普通帐户登陆到putty。

2.打开ipython,生成密码

[root@DS3617xs]# ipython

In [1]: from notebook.auth import passwd

In [2]: passwd()

Enter password: 123456Verify password: 123456Out[2]: 'sha1:f8b5f5dbeca8:d1f5b93d5e787e4bf1bf4ad2c48c177ba79f55dd' #这个秘钥要copy备用

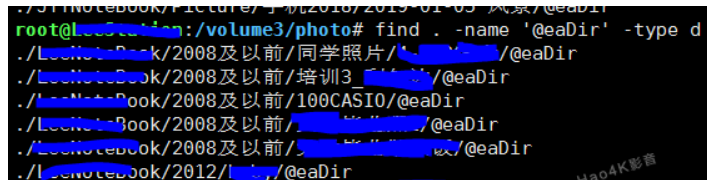

3.生成配置文件( /volume1/docker/anaconda3/为anaconda的安装路径 )

/volume1/docker/anaconda3/bin/jupyter-notebook --generate-config

4.使用vim编辑配置文件

vim /volume1/homes/admin/.jupyter/jupyter_notebook_config.py修改以下选项,修改后保存

# 设置为0.0.0.0 局域网可访问

c.ConnectionFileMixin.ip = '0.0.0.0'

# c.NotebookApp.ip = 'localhost' 改成 本机IP

c.NotebookApp.ip = '172.18.108.101'

# 自定义文件目录

c.NotebookApp.notebook_dir = '/volume1/linux_data/jupyterNotebook/'

#这个就是上面生成的秘钥

c.NotebookApp.password = u'sha1:f8b5f5dbeca8:d1f5b93d5e787e4bf1bf4ad2c48c177ba79f55dd'

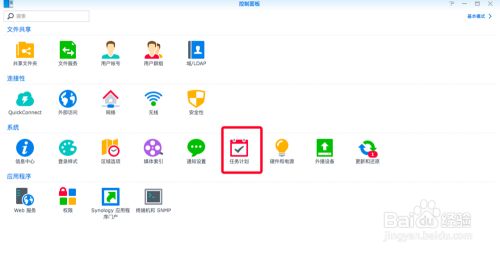

5. 设置开机启动

/volume1/docker/anaconda3/bin/jupyter-notebook

运行jupyter lab出现“Running as root is not recommended. Use –allow-root to bypass”的解决方法(附:jupyte配置方法)

Donald Su 于 2019-07-17 21:51:25 发布 7762 收藏 10

分类专栏: Python

版权

Python

专栏收录该内容

35 篇文章0 订阅

订阅专栏

文章目录

1、问题解决

1-1、产生jupyter配置文件

1-2、修改配置文件

2、jupyter配置

3、jupyter修改密码

1、问题解决

运行jupyter notebook、jupyter lab出现“Running as root is not recommended. Use –allow-root to bypass”错误

可以通过如下方法解决该问题:

1-1、产生jupyter配置文件

使用 jupyter notebook –generate-config 命令生成jupyter配置文件,将会提示当前生成的配置文件的存放路径,一般为 ~/.jupyter/jupyter_notebook_config.py

1-2、修改配置文件

vim ~/.jupyter/jupyter_notebook_config.py打开配置文件,找到 #c.NotebookApp.allow_root = False ,去掉#,并修改为True。

保存该文件,使用jupyter notebook重新运行程序。

关于后台运行jupyter, 可以参考另一片文章:后台运行jupyter notebook程序

2、jupyter配置

使用jupyter notebook,更推荐使用 jupyter lab,这样有浏览操作的功能,非常便捷。安装方法: pip3 install jupyterlab或者pip install jupyterlab。

如果只是临时性使用,推荐如下命令运行jupyter:

jupyter lab –ip 0.0.0.0 –port 8888 –allow-root –no-browser

1

永久有效的配制方法,配置文件产生方法见:上面1-1的方法:

使用 jupyter notebook –generate-config 命令生成jupyter配置文件

使用vim ~/.jupyter/jupyter_notebook_config.py打开配置文件,找到或者直接添加如下内容修改相关配置

c.NotebookApp.ip = ‘0.0.0.0’ # listen on all IPs,远程访问时需要配置该项

c.NotebookApp.port = 55555 #jupyter监听的端口

c.NotebookApp.open_browser = False #是否在键入`jupyter`时打开浏览器

c.NotebookApp.password = ‘argon2:$argon2id$v=19$m=10240,t=10,p=8$yquzhGfZQd0ul/9aC4F7cQ$qMZffPLzgtukdg51uY6+aQ’ #jupyter server密码,生成方法见3的内容。

c.NotebookApp.allow_root = False #是否同意jupyter以root身份运行

1

2

3

4

5

3、jupyter修改密码

终端中键入jupyter notebook password命令,输入密码,生成的密码将会保存在~/.jupyter/jupyter_notebook_config.json文件中。如下图中1所示

使用 cat ~/.jupyter/jupyter_notebook_config.json查看文件内容,将其中password内容提取出来,修改配置文件c.NotebookApp.password的值。

Windows 安装完,需要手动添加环境变量。

Linux 和 MacOS 在安装过程中,会有提示是否设置环境变量。

Windows 添加环境变量需要在电脑->鼠标右键->属性->高级系统设置->环境变量->Path中设置。

D:\Anaconda 为 Anaconda 的安装目录,将下面这两个地址添加到 Path 中即可。

D:\AnacondaD:\Anaconda\Scripts

都配置好后,可以在 cmd 或 Anaconda Prompt 中使用 Anaconda 搭建环境了。

输入指令:

conda create -n your_name jupyter notebook这句话的意思是创建一个名字为 your_name 的虚拟环境,并且这个虚拟环境额外安装 jupyter notebook 第三方库。

可以将 your_name 改为你自己喜欢的名字,这个名字是你的虚拟环境的名字,自己随便取,比如jack。

随后,输入y进行安装:

安装好后,可以通过指令 conda info -e 查看已有环境情况。

从上图可以看到,有两个环境,一个是 base ,自带的基础环境,另一个是我们新创建的名为 jack 的环境。

安装好环境后,我们可以使用指令激活 jack 环境:

activate jack可以看到,我们的环境由 base 变成了 jack 。

接下来,我们就可以在这个环境里,安装自己想要的第三方库,比如 requests。

conda install requests对于 conda 搜不到的包,也可以使用 pip 安装:

python -m pip install xxx需要安装的第三方库安装完毕,可使用命令直接打开 Jupyter Notebook:

jupyter notebook效果如下:

创建一个新的 notebook:

输入代码后,按 Ctrl + Enter 快捷键,即可运行程序:

这个 Jupyter Notebook 使用的环境就是名为 jack 的虚拟环境。

想安装 Pytorch 啥的,直接在这个虚拟环境里安装即可,真香!

2

conda出现错误:

|

1

2

3

4

|

Traceback (most recent call last):

File “/home/sipl/anaconda3/bin/conda”, line 7, in <module>

from conda.cli import main

ModuleNotFoundError: No module named ‘conda’

|

只需要修复下conda即可,可以用原来的安装包进行修复:

./Anaconda3-5.3.1-Linux-x86_64.sh -u